Google presenta su octava generación de chips de IA: TPU 8t y TPU 8i

En el marco de Google Cloud Next 2026, Google anunció la llegada de su octava generación de unidades de procesamiento tensorial (TPU), marcando un hito en la historia del hardware de inteligencia artificial: por primera vez, la compañía divide su chip insignia en dos modelos distintos, cada uno diseñado para un propósito específico.

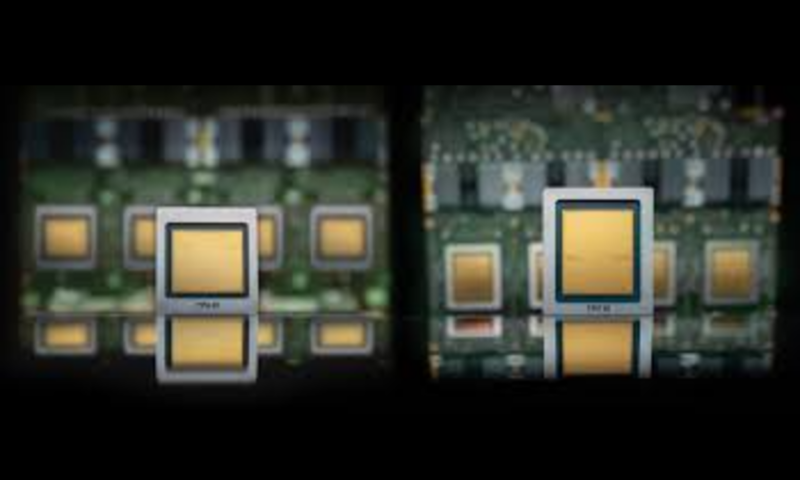

Dos chips, dos misiones

El TPU 8t está pensado como una potencia de entrenamiento, diseñado para cargas de trabajo de alto rendimiento. Ofrece casi tres veces más capacidad de cómputo que la generación anterior, concentra 9.600 chips en un solo superpod y entrega 121 exaflops de cómputo junto a dos petabytes de memoria compartida. Esto significa que tareas de entrenamiento que antes tardaban meses podrían completarse en semanas.

Relacionado: Google presenta TurboQuant, capaz de reducir hasta 6 veces la memoria que necesitan los modelos de IA

El segundo chip, el TPU 8i, apunta en otra dirección: está diseñado para inferencia y aprendizaje por refuerzo, con latencia ultra baja pensada para flujos de trabajo agénticos. Triplica la memoria SRAM a 384 MB, aumenta la memoria de alto ancho de banda a 288 GB y entrega un 80% mejor rendimiento por dólar frente a la generación anterior. En otras palabras, es el chip que hace posible que los agentes de IA respondan de forma rápida e interactiva en tiempo real.

La era agéntica como motor del diseño

La separación en dos chips no es arbitraria. Google explica que la inteligencia artificial ya no se limita a responder preguntas: hoy un agente principal puede descomponer un objetivo en tareas específicas para una flota de agentes especializados que colaboran, preservan estado y aprenden continuamente.

Este nuevo paradigma exige infraestructura diferente para entrenar modelos y para servirlos. El TPU 8t y el TPU 8i son la respuesta de Google a esa dualidad.

¿Una amenaza para NVIDIA?

A pesar del impresionante desempeño anunciado, Google no está reemplazando a NVIDIA; más bien, usa estos chips como complemento a los sistemas basados en GPU que ya ofrece en su nube. De hecho, la compañía prometió que sus instancias A5X estarán equipadas con el nuevo chip Vera Rubin de NVIDIA cuando esté disponible más adelante este año.

Además, Google y NVIDIA están codesarrollando el protocolo de red de código abierto Falcon, con el objetivo de hacer que los sistemas basados en GPU funcionen aun con mayor eficiencia dentro de la infraestructura de Google Cloud.

Con los TPU 8t y 8i, Google refuerza su posición en una carrera tecnológica que no muestra señales de desaceleración. La compañía ya impulsa, con estos chips, sus propios modelos Gemini y sus servicios empresariales, lo que convierte esta infraestructura en el núcleo de su estrategia de IA para los próximos años. El mensaje es claro: Google no solo quiere ser un proveedor de IA, sino que quiere ser el lugar donde esa IA se construye y escala.

Relacionados