La IA superará el intelecto humano y OpenAI quiere controlarlo desde ya

Durante mucho tiempo, la ficción ha recreado un futuro en el que las máquinas superan a los humanos a nivel de inteligencia. Ahora que la inteligencia artificial está en boca de todos, OpenAI ha declarado que esto podría llegar más pronto de lo que imaginamos y desde ya prepara una manera de controlar una eventual «súper inteligencia artificial», también conocida como Inteligencia Artificial General.

Quienes apoyan los avances de este tipo de desarrollos destacan que una inteligencia artificial más avanzada que nuestra mente podría ser fundamental para el futuro de la humanidad. En el mejor de los casos, no sería descabellado que cosas como encontrar la cura a enfermedades que la ciencia no ha podido descifrar, soluciones para el cambio climático, entre otros retos hasta ahora complejos, puedan ser más fáciles de resolver para una máquina con una mayor capacidad intelectual que la nuestra.

De otro lado están los riesgos. ¿Qué hacer si una súper inteligencia comienza a actuar contra la humanidad?, ¿tendremos posibilidad de detenerla? OpenAI quiere prepararse para lo inevitable y ha publicado su primer artículo sobre el tema.

Este año OpenAI estableció un equipo de «superalineación» con la misión de trabajar en cómo detener una inteligencia artificial sobrehumana. El primer artículo de la compañía es simplemente aterrador.

«Todavía no sabemos cómo dirigir y controlar de forma fiable los sistemas de IA sobrehumanos».

OpenAI

Con una total naturalidad, la compañía anunció: «Creemos que la superinteligencia, una IA mucho más inteligente que los humanos, podría desarrollarse en los próximos diez años. Sin embargo, todavía no sabemos cómo dirigir y controlar de forma fiable los sistemas de IA sobrehumanos».

Antes de convertirse en la millonaria empresa que es hoy, OpenAI se creó en 2015 con la misión de construir una inteligencia artificial que beneficie a toda la humanidad, incluso cuando esa IA se vuelva considerablemente más inteligente que sus creadores.

El momento más crucial para ese objetivo parece estar llegando, pues la misma compañía dijo que «resolver este problema es esencial para garantizar que incluso los sistemas de IA más avanzados en el futuro sigan siendo seguros y beneficiosos para la humanidad».

El reto de controlar los modelos sobrehumanos de IA

OpenAI ha dicho que dedicará una quinta parte de su potencia de cálculo disponible al proyecto ‘Superalignment’ (superalinemiento).

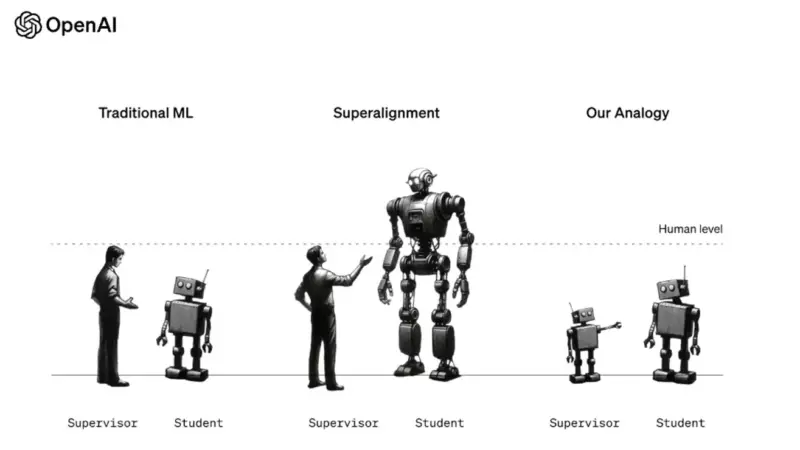

Para asegurarse de que en un tiempo estos sistemas de IA más inteligentes que los humanos se mantengan bajo las reglas establecidas por los humanos, OpenAI presentó una primera solución en su artículo. Se trata de diseñar pequeños modelos de IA para controlar modelos IA sobrehumanos.

En la actualidad, OpenAI utiliza humanos para «alinear» a ChatGPT. Personas se encargan de darle al sistema una retroalimentación positiva o negativa de lo que esté va haciendo para, de esta manera, asegurarse de que ChatGPT no recomiende a las personas cosas peligrosas o use un lenguaje inadecuado.

¿El problema? Con el lanzamiento de GPT-4 y futuras versiones del LLM, ChatGPT está haciendo más inteligente, por lo que OpenAI reconoce que los humanos no serán suficientes para entrenar estos modelos.

El aquí donde tendrán protagonismo los pequeños modelos. La compañía dice que es necesario entrenar una IA menos complicada para que «modere» a las más inteligentes.

Relacionados