Inteligencia Artificial de Facebook es capaz de identificar memes ofensivos

Facebook desarrolló una inteligencia artificial que ayuda a los moderadores a identificar memes ofensivos publicados en la red social.

Actualmente, las redes sociales se han tomado en serio la supervisión de los contenidos publicados por los usuarios para evitar insultos y comentarios ofensivos. En abril de este año, Facebook anunció nuevas normas secretas para censurar publicaciones, de manera que cualquier persona puede consultar qué está permitido y qué no.

Según las normas comunitarias de Facebook, están prohibidas conductas violentas o comentarios ofensivos de cualquier índole; fomentar el suicidio o las autolesiones, los desnudos y la explotación sexual, el bullying o el acoso; también están prohibidos los comportamientos que atenten contra la integridad y la autenticidad, además se exige el respeto a la propiedad intelectual.

Para lograr evitar este tipo de comportamientos, Facebook cuenta con un equipo de moderadores humanos, que son los encargados de revisar los contenidos denunciados por otras personas y supervisar que los usuarios cumplen con las normas comunitarias.

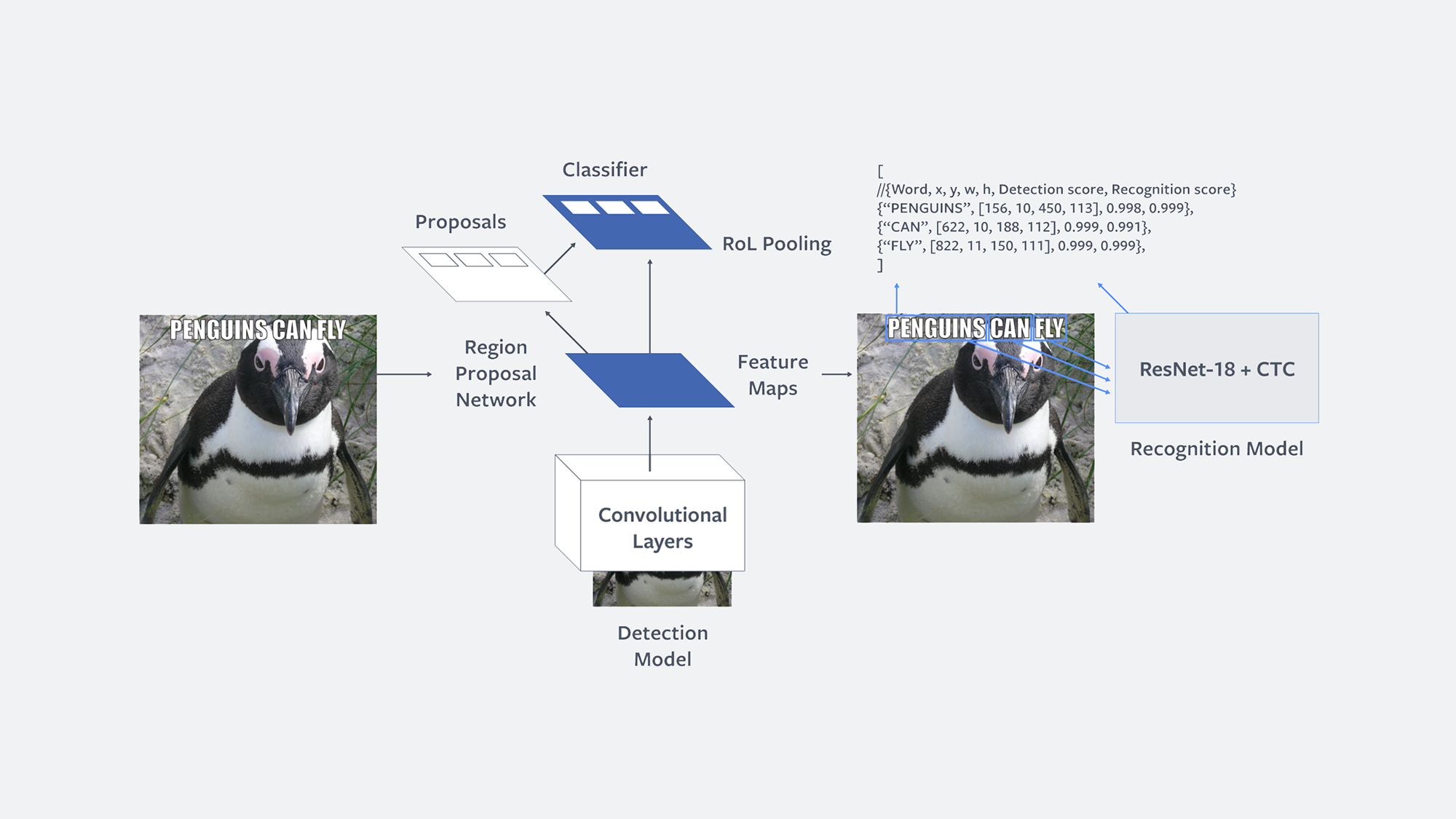

Sin embargo, conociendo los millones de contenidos que a diario se comparten en la red social, no es tarea fácil detectar aquellos que incumplen las normas. Y es aquí donde entra Rosetta, la IA que Facebook creó para detectar memes, fotos y vídeos ofensivos de manera automática.

La inteligencia artificial antes mencionada es capaz de extraer el texto de todas las imágenes publicadas en Facebook e Instagram. Luego, lo introduce en un modelo entrenado para comprender texto y la imagen como un conjunto, y de esta manera saber si se trata de un contenido inofensivo o si viola las normas de la comunidad.

Esto supone una gran ayuda para que la plataforma pueda evitar que se compartan memes, vídeos y comentarios inadecuados.

Relacionados